医療分野へのAI(人工知能)応用が急ピッチで進んでいます。しかしながら医療行為には責任が伴うため、この分野には、政府による規制が数多く存在します。人工知能の特徴のひとつである自己学習機能を、規制の枠組みにどう位置付けていくのが、難しい決断が迫られそうです。

診断の分野ではAIが圧勝するケースが続出

このところ医師とAIの競争において、AIが圧勝するケースが続出しています。オランダの大学が実施した乳がんの画像診断コンテストでは、AIの判断が人間の判定を大きく上回る結果を出しました。

病理診断の分野は、医師自身の目と経験がモノを言う、いわゆる職人技の世界として知られており、病理医が一人前になるまでには10年はかかるとも言われてきました。特に日本では慢性的な病理医不足に悩まされており、一部の病院では診断業務に支障を来しています。

AIの判定が人間を上回るのであれば、病理医は最終的なチェックのみを行い、基本的な判定はAIが行うという手法がかなり現実味を帯びてくるでしょう。

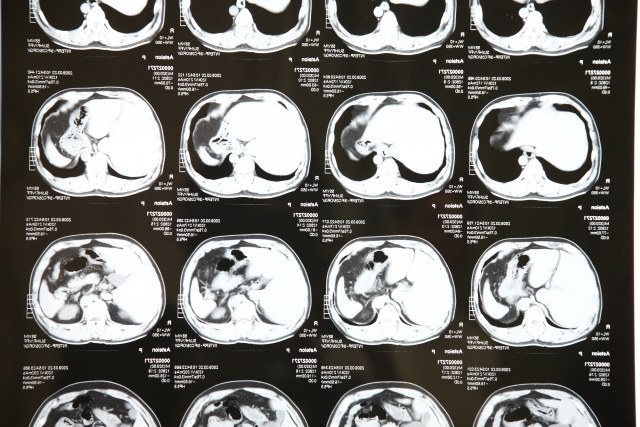

AIの応用は病理診断の分野だけではありません。画像解析の技術は、レントゲンやCTスキャン、あるいはMR(核磁気共鳴画像装置)など、臨床の分野にも着実に浸透しています。近い将来、得られた情報を総合して、AIが所見を作成したり、治療方針の立案を行うことは珍しいことではなくなっているはずです。

自己進化した医療機器の許認可をどうするのか?

しかしながら、医療業務の多くをAIで代替することができたとしても大きな問題が残ります。それは最終的な責任を誰が負うのかという部分です。

厚生労働省では、AI時代においても、すべては医師主導で医療業務を進めるとの方向性を打ち出しており、最終的な意思決定やその責任は医師が負うという方針を打ち出しています。極めて常識的な内容であり、これに反対する人はほとんどいないでしょう。

しかしながら、AI化を本格的に進めていくためには、これだけでは不十分です。なぜなら、AIの自己学習能力をどう位置付けるのかが不明確だからです。

現在、医療機器は、政府が認可したものしか使うことはできません。しかし、AIを搭載した機器類は、ディープラーニング(深層学習)機能を活用し、自ら能力を向上させることができます。しかもディープラーニングの場合、なぜそのような結果になったのか、人間がすぐに判断できるとは限りません。

自らの力で進化したAIはもはや認可された時点での医療機器とは異なる存在ですが、これをどう位置付けていくのか、なかなか難しい問題となるでしょう。米国では、AIを使った医療機器は、認可の対象から除外する動きも出ているようです。

自己学習能力を認めなければAIとしての効果の多くが失われますが、自己学習に対して一切、制限をかけなかった場合、想像もしなかったトラブルを招く危険性もあります。

これは、医療のみならず、安全性の担保が必要なあらゆる業界で共通のテーマとなってくるでしょう。その時になって慌てないよう、今から積極的に議論を進めておく必要がありそうです。